با توجه به پذیرش سریع و اغلب موقتی ChatGPT و دیگر پلتفرمهای هوش مصنوعی مولد، وقت آن رسیده است که سازمانها یک خطمشی هوش مصنوعی مولد ایجاد کنند.

در حالی که ChatGPT OpenAI و مدلهای زبان بزرگ مشابه به سرعت در حال یافتن راه خود در گردشهای کاری سازمانی هستند، سازمانها نگرانیهایی در مورد ارائه نتایج نادرست هوش مصنوعی و همچنین حفظ حریم خصوصی و امنیت دادهها دارند. به همین دلیل است که آیا، کی، و نحوه اتخاذ هوش مصنوعی مولد نباید به قضاوت تک تک کارکنان واگذار شود.

در این مقاله، همه چیزهایی را که باید در مورد ایجاد یک خطمشی هوش مصنوعی مولد برای کسبوکارتان بدانید، و همچنین یک الگوی خطمشی استفاده از هوش مصنوعی برای دانلود رایگان ارائه میکنیم.

مطالب

هوش مصنوعی مولد (ChatGPT) چیست؟

چرا سازمان ها به یک سیاست هوش مصنوعی مولد نیاز دارند؟

نمونه هایی از شرکت هایی که سیاست های هوش مصنوعی مولد را اجرا می کنند

چگونه یک سیاست هوش مصنوعی مولد ایجاد کنیم

الگوی خط مشی استفاده از هوش مصنوعی

هوش مصنوعی مولد (ChatGPT) چیست؟

ChatGPT، ربات چت هوش مصنوعی OpenAI که متن تولید می کند، جهان را در طوفان فرو برده است. در زمان انتشار، این اپلیکیشن به سریعترین رشد در تاریخ تبدیل شد و Big Tech را بر آن داشت تا در پاسخ به آن، چترباتهای دیگری را راهاندازی کند.

مدل زبان میتواند به سؤالات پاسخ دهد و به افراد در انجام وظایف کاری مختلف، مانند ایدههای طوفان فکری، نوشتن ایمیل و محتوا، نوشتن کد، و تجزیه و تحلیل دادهها بر اساس پیامهای متنی کوتاه کمک کند. با افزایش مهارتها و تواناییهای موجود افراد، سازمانها را قادر میسازد هوشمندتر کار کنند و بهرهوری را افزایش دهند.

اما یک جنبه تاریک نیز دارد. هوش مصنوعی مولد همچنین می تواند چیزهایی را بسازد، پدیده ای که به عنوان توهم هوش مصنوعی شناخته می شود. میتواند دادههای نادرست یا نادرست تولید کند و از دادههای موجود استنتاج نادرستی بگیرد.

بنابراین، چالشهای ChatGPT در تضمین کیفیت محتوا، پیمایش نگرانیهای اخلاقی و به حداقل رساندن خطر تولید محتوای گمراهکننده، جعلی یا کاملاً شیطانی نهفته است.

کارمندانی که از ChatGPT (و سایر هوش مصنوعی مولد) در محل کار استفاده می کنند چگونه هستند؟

کارمندان به طور فزایندهای در حال ادغام ChatGPT و سایر ابزارهای مولد هوش مصنوعی در جریان کار روزانه خود هستند. در تولید محتوا، این مدلهای هوش مصنوعی به تهیه پیشنویس مقالات و کپی تبلیغات و تقویت محتوای نوشتاری کمک میکنند.

آنها همچنین در پشتیبانی مشتری برجسته هستند و به عنوان راه حل های خط مقدم چت ربات برای پاسخ به سؤالات متداول، راهنمایی عیب یابی و بهبود تجربه کلی مشتری عمل می کنند. در تحقیق و تجزیه و تحلیل داده ها، هوش مصنوعی مولد به پیش بینی الگوها، شبیه سازی سناریوها و ارائه بینش از مجموعه داده های عظیم کمک می کند.

در بخشهای خلاق، هوش مصنوعی مولد به طوفان فکری و ایجاد مفاهیم طراحی نوآورانه کمک میکند. توسعه دهندگان از ابزارهای هوش مصنوعی برای کمک به کدنویسی، تشخیص اشکال و بهینه سازی نرم افزار استفاده می کنند. متخصصان منابع انسانی آنها را برای کارهای مختلف مانند استخدام، حضور در هیئت مدیره و تجزیه و تحلیل افراد به کار می گیرند.

کاربردهای بالقوه گسترده است. همانطور که فناوری هوش مصنوعی مولد پیشرفت می کند، ادغام آن در کارکردهای مختلف شغلی برای گسترش، اصلاح و اختراع مجدد فرآیندهای کاری سنتی و افزایش گردش کار موجود تنظیم شده است.

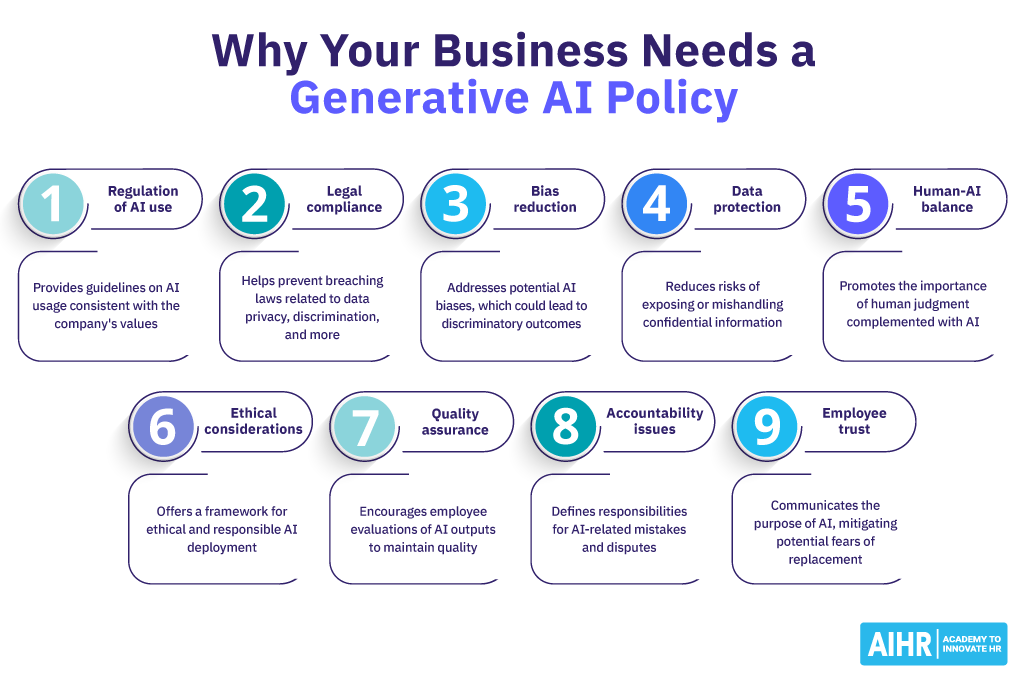

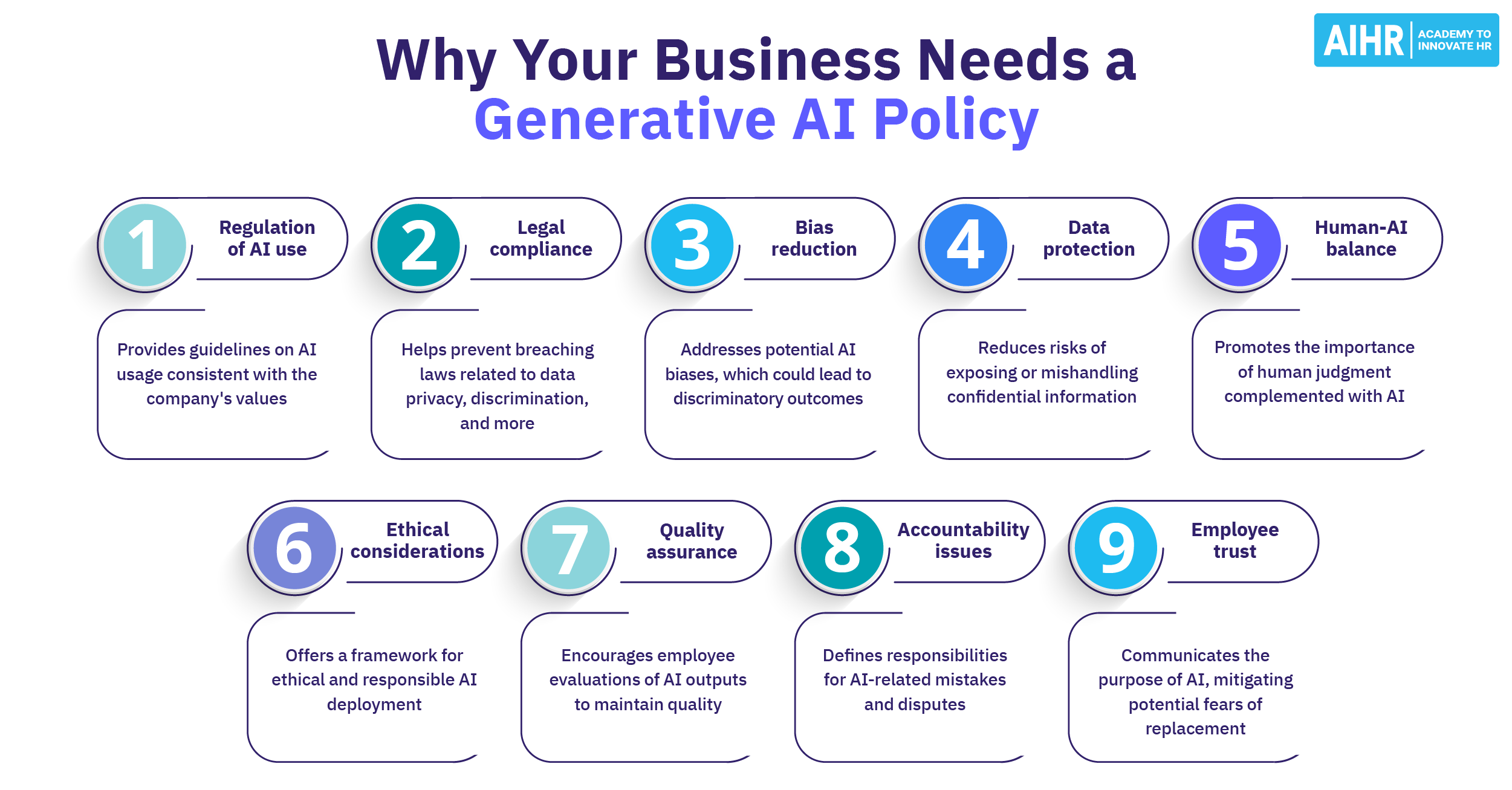

چرا سازمان ها به یک سیاست هوش مصنوعی مولد نیاز دارند؟

بدون ارائه راهنمایی به کارکنان خود در مورد نحوه استفاده از هوش مصنوعی مولد در محل کار، سازمان ها در معرض خطر سوء استفاده، معضلات اخلاقی، کاهش بهره وری و آسیب احتمالی به شهرت خود هستند.

بیایید نگاهی دقیق تر به مزایای داشتن یک خط مشی هوش مصنوعی مولد بیندازیم:

- تنظیم نحوه استفاده کارکنان از هوش مصنوعی در محل کار : یک خط مشی هوش مصنوعی مولد دستورالعمل هایی را برای نحوه استفاده کارگران از هوش مصنوعی به گونه ای که با ارزش ها و استانداردهای اخلاقی شرکت مطابقت دارد ارائه می کند.

- جلوگیری از تخلفات قانونی : بدون نظارت مناسب، سازمان ها ممکن است ناآگاهانه قوانین مربوط به حریم خصوصی داده ها، تبعیض یا سایر زمینه ها را نقض کنند. به عنوان مثال، قانون ابزار تصمیم گیری خودکار استخدامی شهر نیویورک، کارفرمایان را موظف می کند که به طور منظم ممیزی های شخص ثالث را از فناوری استخدام هوش مصنوعی خود انجام دهند.

- کاهش تعصب و تبعیض : مدلهای هوش مصنوعی ممکن است تعصبهای موجود در دادههای آموزشی خود را تکرار یا حتی تقویت کنند. این می تواند منجر به نتایج مغرضانه یا حتی تبعیض آمیز شود، برای مثال، اگر از هوش مصنوعی برای استخدام استفاده شود. یک سیاست هوش مصنوعی مولد می تواند به نحوه استفاده از هوش مصنوعی در تصمیم گیری بپردازد.

- حفاظت از داده های حساس : یک خط مشی AI مولد قوی خطر افشای ناخواسته، سوء استفاده یا سوء استفاده از اطلاعات محرمانه کارکنان یا شرکت را به حداقل می رساند، که می تواند منجر به نقض اعتماد و عواقب قانونی احتمالی شود.

- ایجاد تعادل بین ورودی انسان و هوش مصنوعی : این سیاست بر ارزش غیرقابل جایگزینی تخصص انسانی تاکید می کند و رویکردی متعادل را ترویج می کند که در آن هوش مصنوعی به جای جایگزینی، قضاوت انسان را تکمیل می کند، به خصوص در سناریوهای ظریف.

- پرداختن به نگرانیهای اخلاقی : با وجود دستورالعملهای اخلاقی واضح، یک خطمشی هوش مصنوعی مولد چارچوبی برای استقرار هوش مصنوعی مسئولانه فراهم میکند و تعادلی بین کارایی، شفافیت و حریم خصوصی کارکنان و مشتریان ایجاد میکند.

- کیفیت و دقت نظارت : داشتن یک خط مشی سازمان ها و کارمندان را ترغیب می کند تا به طور منظم خروجی های هوش مصنوعی را ارزیابی و تأیید کنند. این اطلاعات نادرست، تصمیمات ضعیف و خروجی های نادرست را کاهش می دهد.

- ارتقای مسئولیتپذیری و مسئولیتپذیری : یک خطمشی روشن AI مسیری از مسئولیتپذیری و مسئولیتپذیری را برای مدیریت مؤثر و سریع موقعیتهایی که هوش مصنوعی اشتباه میکند یا باعث آسیب میشود، تعریف میکند، که به جلوگیری از اختلافات داخلی یا چالشهای قانونی کمک میکند.

- تقویت اعتماد کارمندان : با بیان شفاف هدف و محدودیتهای ابزارهای هوش مصنوعی، این سیاست به کارکنان اطمینان میدهد، ترس از جایگزینی یا نظارت بیش از حد را کاهش میدهد و روحیه سازمانی را حفظ میکند.

مقررات و نظارت مؤثر بر استفاده از هوش مصنوعی در محیط کار از طریق یک سیاست هوش مصنوعی مولد می تواند به کاهش این خطرات کمک کند و اطمینان حاصل کند که این فناوری به طور مسئولانه و اخلاقی استفاده می شود.

نمونه هایی از شرکت هایی که سیاست های هوش مصنوعی مولد را اجرا می کنند

سامسونگ پس از مشاهده نشت داده های ChatGPT، استفاده از هوش مصنوعی را ممنوع کرد

در ماه مه 2023، سامسونگ کارمندان خود را از استفاده از ابزارهای هوش مصنوعی مانند ChatGPT منع کرد. این ممنوعیت پس از آن صورت گرفت که شرکت متوجه شد کارکنان آنها کدهای حساسی را در این پلتفرمهای هوش مصنوعی آپلود کردهاند.

سامسونگ نگران بود که دادههای ارسال شده به پلتفرمهای هوش مصنوعی مانند ChatGPT در سرورهای خارجی ذخیره میشوند و بازیابی و حذف آن را دشوار میکند و این دادهها میتوانند به طور بالقوه برای کاربران دیگر افشا شوند. همه ورودیها بخشی از پروتکل یادگیری فناوری هستند و این عمل را به موضوع مالکیت معنوی تبدیل میکند.

Expedia ChatGPT را به طور گسترده مستقر می کند

گروه Expedia از هوش مصنوعی برای ساده کردن تجربه سفر برای مسافران و شرکای B2B استفاده می کند. این شرکت مسافرتی میگوید سه عنصر حیاتی برای موفقیت هوش مصنوعی مولد مورد نیاز است: یک پلتفرم فناوری قوی، دادههای با کیفیت بالا و فرهنگ هوش مصنوعی.

این سازمان ChatGPT OpenAI را در برنامه Expedia ادغام کرد تا برنامه ریزی سفر مکالمه را ارائه دهد. آنها همچنین بازخرید اعتبار هوایی را ساده کردند و رزرو پرواز و استفاده از اعتبار هوایی خود را برای مسافران آسانتر کردند.

با پشتیبانی از پردازش زبان طبیعی، نماینده مجازی آن به مسافران کمک می کند تا سوالات را حل کنند و در هزینه های عملیاتی قابل توجهی صرفه جویی کرده است. سرمایه گذاری در تحول فناوری و هوش مصنوعی با ایجاد امکان توسعه سریع محصول، کارایی، خلاقیت و رشد، ارزشی را به ارمغان آورده است.

Expedia نظارت دقیقی بر حاکمیت، اخلاقیات و ملاحظات حفظ حریم خصوصی در به اشتراک گذاری هر یک از اطلاعات خود دارد. تمرکز بر روی کار کردن با یکدیگر به عنوان یک جامعه مشخص برای استفاده از هوش مصنوعی و اطمینان از اعمال بهترین شیوه ها در سراسر صنعت است.

Salesforce مدل های هوش مصنوعی را با داده های CRM ترکیب می کند

Salesforce’s Einstein GPT یک ابزار هوش مصنوعی است که در پلتفرم Salesforce یکپارچه شده است. این مدلهای هوش مصنوعی عمومی و خصوصی را با دادههای CRM ترکیب میکند و به کاربران اجازه میدهد درخواستهای زبان طبیعی را بپرسند و محتوای تولید شده توسط هوش مصنوعی را دریافت کنند. دادههای بیدرنگ از ابر Salesforce و Salesforce Data Cloud به این مدلها وارد میشوند تا دادههای مشتری را متحد کنند.

لایه اعتماد Einstein GPT با جلوگیری از حفظ داده های حساس مشتری توسط مدل های بزرگ زبان (LLM) حریم خصوصی و امنیت داده ها را تضمین می کند. این یک استاندارد صنعتی جدید را برای هوش مصنوعی سازمانی قابل اعتماد ایجاد کرده است – ارائه مزایای هوش مصنوعی مولد در حالی که حفظ حریم خصوصی داده ها و امنیت داده ها را فراهم می کند.

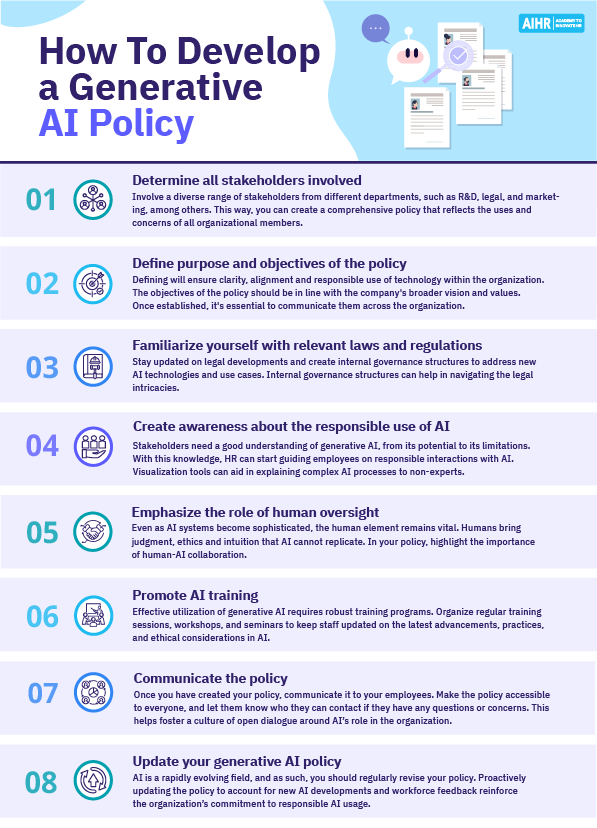

چگونه یک سیاست هوش مصنوعی مولد ایجاد کنیم

ایجاد یک خط مشی مولد هوش مصنوعی برای نیروی کار شما یک کار پیچیده با ملاحظات بسیاری است. در اینجا 8 مرحله وجود دارد که می توانید برای اجرای موفقیت آمیز خط مشی جدید دنبال کنید:

1. همه ذینفعان درگیر را تعیین کنید

درگیر کردن طیف متنوعی از ذینفعان به شما این امکان را می دهد که خط مشی ای جامع و همسو با اهداف سازمانی و همچنین روندها و مقررات جهانی ایجاد کنید.

تعیین کنید چه کسانی تحت تأثیر این سیاست قرار خواهند گرفت، مانند کارمندان بخشهای مختلف، پیمانکاران و رهبری. شما باید درک کنید که ذینفعان شما از هوش مصنوعی مولد برای تعیین دستورالعملهای کاربر واضح استفاده میکنند.

نمایندگانی از تمام بخشهای سازمان، از جمله تحقیق و توسعه هوش مصنوعی، ریسک و انطباق، حقوقی، ارتباطات، بازاریابی و فروش را درگیر کنید.

نکته : به طور منظم این گروه را برای جمع آوری بازخورد و بررسی خط مشی دعوت کنید. این به شما کمک می کند تا خط مشی مرتبط و به روز را در چشم انداز هوش مصنوعی که به سرعت در حال تحول است حفظ کنید.

2. هدف و اهداف سیاست را تعریف کنید

تعریف هدف و اهداف یک خط مشی مولد هوش مصنوعی به عنوان ستون اساسی آن عمل می کند و جهت و اصول راهنما را تعیین می کند. این امر وضوح، همسویی و استفاده مسئولانه از فناوری در سازمان شما را تضمین می کند.

اهداف، اهداف عملی هستند که سازمان شما قصد دارد از طریق خط مشی به آنها دست یابد. آنها نتایج یا اصولی خاص و قابل اندازه گیری را ارائه می دهند که اجرای و کاربرد فناوری را هدایت می کند.

اهداف خط مشی باید در راستای چشم انداز و ارزش های گسترده تر شرکت باشد. پس از ایجاد، برقراری ارتباط با آنها در سراسر سازمان ضروری است.

نکته: هنگام تهیه پیش نویس اهداف خاص، استفاده اخلاقی از هوش مصنوعی، شفافیت، حریم خصوصی داده ها، امنیت، نظارت و یادگیری مستمر را در نظر بگیرید.

3. با قوانین و مقررات مربوطه آشنا شوید

یکی از عوامل مهمی که باید هنگام تعیین نحوه استفاده نیروی کارتان از هوش مصنوعی مولد در نظر بگیرید، قوانین و مقرراتی است که سازمان شما باید از آنها پیروی کند. به عنوان مثال، ممکن است محدودیتهایی در مورد مواردی که کارکنان شما نمیتوانند از هوش مصنوعی استفاده کنند در نظر بگیرید.

قوانین حفظ حریم خصوصی، چه در ایالات متحده و چه در سطح بینالمللی، الزاماتی را برای جمعآوری، استفاده و اشتراکگذاری دادههای مربوط به سیستمهای هوش مصنوعی وضع میکنند. این قوانین حفظ حریم خصوصی عبارتند از:

- حق انصراف از پروفایل خودکار

- افشای عمومی پروفایل های خودکار و استنباط

- رضایت برای استفاده

- محدودیت در اشتراک گذاری با پلتفرم های هوش مصنوعی شخص ثالث

- قوانین افشای چت بات

- حقوق حذف، دسترسی و تصحیح داده های شخصی

اصولی مانند محدودیت هدف، به حداقل رساندن داده ها و اجتناب از الگوهای تاریک نیز به موارد استفاده از سیستم هوش مصنوعی مرتبط است.

در نظر بگیرید که این قوانین و مقررات چگونه بر کاربران هوش مصنوعی مولد در سازمان شما تأثیر می گذارد. سپس، می توانید در خط مشی خود به این موضوع بپردازید.

نکته: از تحولات قانونی بهروز باشید و ساختارهای حاکمیت داخلی را برای رسیدگی به فناوریهای جدید هوش مصنوعی و موارد استفاده ایجاد کنید.

4. ایجاد آگاهی در مورد استفاده مسئولانه از هوش مصنوعی

ذینفعان شما نیاز به درک خوبی از هوش مصنوعی مولد، قابلیتهای آن، موارد استفاده بالقوه، خطرات و مزایای آن برای استفاده مسئولانه از آن دارند.

این مدلها برای تشخیص الگوها و روابط در مقیاس کوچک و فراگیر در مجموعههای دادهای که از انواع منابع، از جمله اینترنت، کتابها، کتابخانههای تصویری و غیره میآیند، آموزش دیدهاند.

مدلهای مولد هوش مصنوعی و ChatGPT «جعبهی سیاه» هستند – هیچ توضیحی برای چگونگی نتیجهگیری ارائه نمیدهند. حتی شرکت های پشت سر آنها نمی توانند به طور کامل توضیح دهند که دقیقا چگونه کار می کنند.

با پرورش این دانش بنیادی، منابع انسانی میتواند کارمندان را در تعاملات مسئولانه با هوش مصنوعی راهنمایی کند.

نکته: از ابزارهای تجسمی استفاده کنید که میتوانند نشان دهند که مدلهای هوش مصنوعی چگونه نتایج را به شکل سادهشده تولید میکنند. این باعث می شود که عملیات پیچیده هوش مصنوعی برای افراد غیر متخصص در دسترس تر و آسان تر باشد.

5. بر نقش نظارت انسانی تأکید کنید

حتی زمانی که سیستمهای هوش مصنوعی مولد پیچیدهتر میشوند، عنصر انسانی در استقرار هوش مصنوعی غیرقابل جایگزین باقی میماند. مشارکت انسان لایهای از قضاوت، اخلاق و شهود را ارائه میکند که هوش مصنوعی، صرف نظر از پیچیدگی آن، نمیتواند آن را تکرار کند.

در خط مشی هوش مصنوعی خود، اهمیت همکاری انسان و هوش مصنوعی را برجسته کنید.

انسانها میتوانند زمینه، تفاوتهای فرهنگی و مفاهیم ظریف را به روشهایی تشخیص دهند که هوش مصنوعی نمیتواند. با گنجاندن نظارت انسانی در استفاده از هوش مصنوعی، سازمان شما میتواند خطرات را کاهش دهد، ملاحظات اخلاقی را رعایت کند و تضمین کند که تصمیمات با ارزشهای سازمانی و هنجارهای اجتماعی همسو هستند.

شما همچنین باید مکانیسم های پاسخگویی را ایجاد کنید. آنها باید خطوط مسئولیت روشنی را برای رسیدگی و اصلاح هر گونه مشکلی که خطاهای سیستم های هوش مصنوعی نتایج ناخواسته ای ایجاد می کند ایجاد کنند.

نکته : یک رویکرد «تیمینگ قرمز» را اجرا کنید، که در آن یک تیم اختصاصی به طور منظم خروجیهای هوش مصنوعی را به چالش میکشد و آزمایش میکند، دقیقاً مانند یک مدافع شیطان. این فرهنگ نظارت را تشویق میکند و میتواند نقصها یا سوگیریهای پیشبینی نشده در سیستم هوش مصنوعی را شناسایی کند. به این ترتیب، به تیمهای خود قدرت میدهید تا تصمیمهایی بگیرند که هم اطلاعاتی داشته باشند و هم از نظر اخلاقی صحیح باشند.

6. آموزش هوش مصنوعی را ترویج دهید

آموزش صحیح در مورد استفاده از هوش مصنوعی مولد به اعضای تیم در بخشهای مختلف اجازه میدهد تا بهتر از پتانسیل آن قدردانی کرده و از آن استفاده کنند. شما همچنین باید این نکته را در خط مشی خود ذکر کنید.

تنها 14 درصد از کارمندان گزارش داده اند که در مورد استفاده از ابزارهای هوش مصنوعی آموزش دیده اند، در حالی که 86 درصد می گویند که به چنین ارتقای مهارتی نیاز دارند.

برگزاری یک جلسه آگاهی برای برجسته کردن پیامدهای اجتماعی گسترده تر، سوگیری ها و نگرانی های مرتبط با هوش مصنوعی را در نظر بگیرید. شما نیاز دارید که کارکنانتان نه تنها از نظر فنی مهارت داشته باشند، بلکه از نظر اخلاقی نیز آگاه باشند.

جلسات آموزشی منظم، کارگاه ها و سمینارها را ترتیب دهید تا کارکنان را در مورد آخرین پیشرفت ها، بهترین شیوه ها و ملاحظات اخلاقی در هوش مصنوعی به روز نگه دارید. پاسخگویی به مخاطبان گسترده ای، از تیم های فنی که مستقیماً با هوش مصنوعی کار می کنند تا کارکنان غیر فنی که ممکن است با خروجی های هوش مصنوعی تعامل داشته باشند یا تحت تأثیر آنها قرار گیرند.

نکته: یک نشان دیجیتال یا سیستم صدور گواهی را برای آموزش هوش مصنوعی در سازمان خود پیاده کنید. این نه تنها کارمندان را برای مشارکت فعال ترغیب می کند، بلکه مهارت هوش مصنوعی آنها را ردیابی و به نمایش می گذارد.

7. خط مشی را ابلاغ کنید

هنگامی که خط مشی هوش مصنوعی مولد خود را ایجاد کردید، وقت آن است که از آن استفاده کنید. به کارمندان و رهبری خود در میان بگذارید که اهداف اصلی این خط مشی چیست، چه مواردی را پوشش می دهد و کجا می توانند آن را پیدا کنند.

خط مشی را برای همه افراد شرکت در دسترس قرار دهید. به عنوان مثال، می توانید آن را در اینترانت یا ویکی داخلی سازمان خود آپلود کنید و سپس یک به روز رسانی در سراسر شرکت را با یک پیوند به اشتراک بگذارید. همچنین می توانید از مدیران بخواهید که خط مشی جدید یا به روز شده را به اعضای تیم خود یادآوری کنند.

به کارمندان اجازه دهید تا در صورت داشتن هرگونه سوال یا نگرانی با چه کسی تماس بگیرند. این به شما کمک می کند فرهنگ گفتگوی باز را در مورد نقش هوش مصنوعی در سازمان پرورش دهید.

نکته : از ابزارهای چندرسانهای مختلف، مانند اینفوگرافیک، برای جذابتر کردن و درک آسانتر ارتباطات خطمشی استفاده کنید. این می تواند به حفظ و درک بهتر کارمندان کمک کند.

8. خط مشی هوش مصنوعی مولد خود را به طور منظم به روز کنید

خط مشی هوش مصنوعی شما یک سند ثابت نیست. با پیشرفتهای سریع در دنیای هوش مصنوعی، باید بهطور منظم این خطمشی را مرور کنید تا مطمئن شوید که با آخرین پیشرفتهای هوش مصنوعی، ملاحظات اخلاقی در حال ظهور و بازخورد نیروی کار همسو میشود.

چنین به روز رسانی های پیشگیرانه ای تعهد سازمان را به استفاده مسئولانه از هوش مصنوعی تقویت می کند. آنها همچنین اعتماد به نفس را در کارمندان القا می کنند و به آنها اطمینان می دهند که تعامل آنها با هوش مصنوعی توسط یک چارچوب مدرن و پاسخگو اداره می شود.

نکته : یک چرخه بررسی برای خط مشی تنظیم کنید و گروه متنوعی از ذینفعان را در فرآیند بررسی قرار دهید. این تضمین می کند که چندین دیدگاه در طول به روز رسانی در نظر گرفته شود.

الگوی خط مشی استفاده از هوش مصنوعی مولد

برای جمع بندی

اگر میخواهید مطمئن شوید که کارمندانتان از ChatGPT و سایر فناوریهای هوش مصنوعی به روشی مسئولانه و اخلاقی استفاده میکنند، توسعه یک خطمشی هوش مصنوعی مولد ضروری است. چنین سیاستی دستورالعملهای روشنی را برای استفاده از هوش مصنوعی در محل کار برای نیروی کار شما تعیین میکند و به کارکنان کمک میکند تا پیچیدگیهای این فناوری را مرور کنند.

با ایجاد یک خط مشی جامع و شفاف، سازمان ها می توانند از قدرت هوش مصنوعی بهره ببرند و در عین حال خطرات سوء استفاده و چالش های اخلاقی را کاهش دهند.

دیدگاهتان را بنویسید