هوش مصنوعی در استخدام یکی از کاربردهای کلیدی هوش مصنوعی در فعالیت های منابع انسانی بوده است. تقریباً از هر 4 شرکت، 3 شرکت در فرآیندهای استخدام و استخدام خود حداقل تا حدی از هوش مصنوعی استفاده می کنند. با ظهور هوش مصنوعی مولد، این تعداد فقط افزایش می یابد.

قوانین جدید، مانند قانون هوش مصنوعی اتحادیه اروپا و قانون تعصب هوش مصنوعی نیویورک، توجه را به خطرات هوش مصنوعی برای منابع انسانی جلب کرده است. سازمانها باید به اتخاذ راهحلهای هوش مصنوعی مسئولانه نزدیک شوند تا از مزایای کامل آنها بهره ببرند.

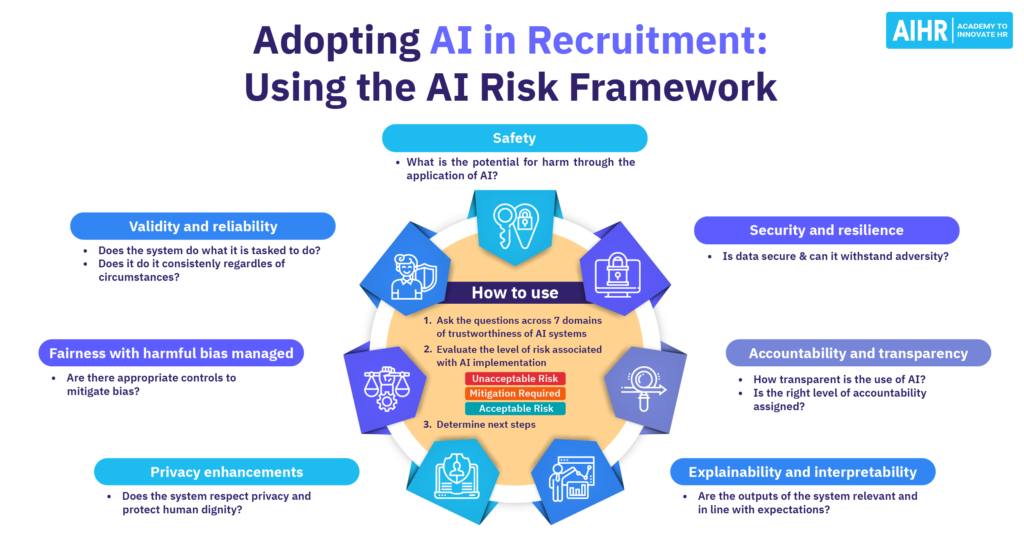

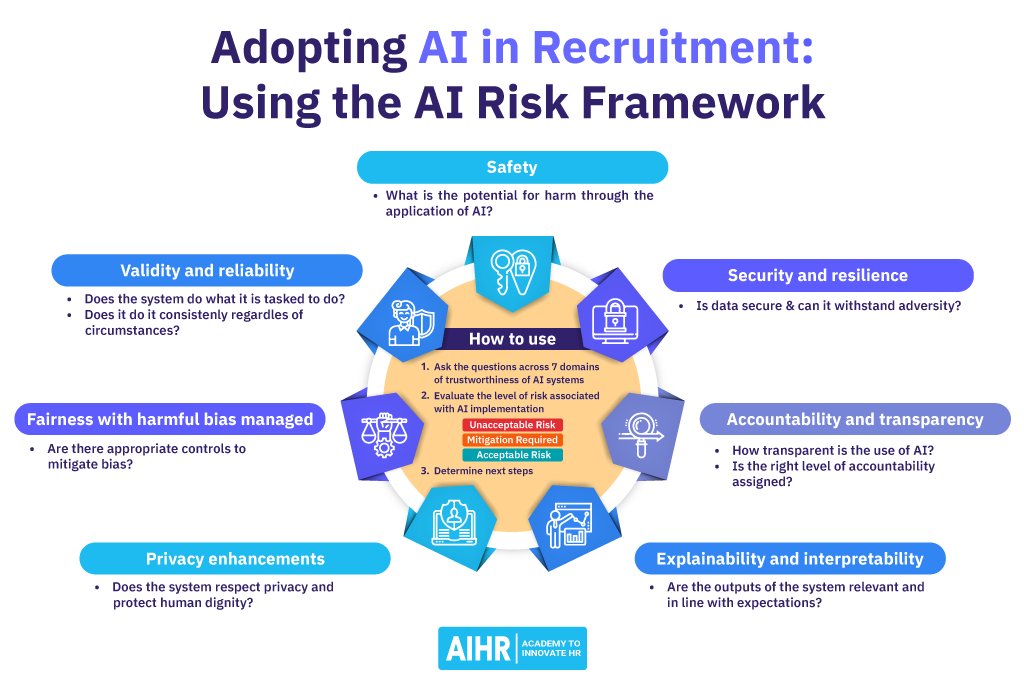

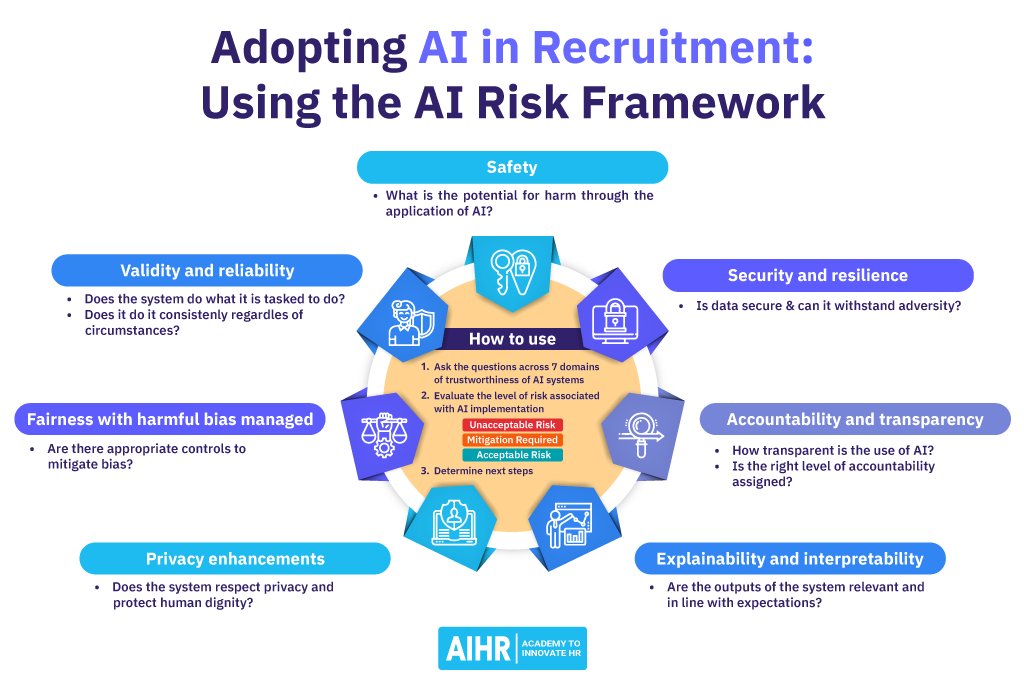

در این مقاله، ما یک چارچوب ریسک هوش مصنوعی را مورد بحث قرار میدهیم که میتواند برای ارزیابی قابلیت اعتماد فناوریهای هوش مصنوعی، بهویژه تمرکز بر استفاده از چارچوب برای استخدام استفاده شود.

مطالب

وضعیت فعلی هوش مصنوعی در استخدام

استفاده از چارچوب ریسک هوش مصنوعی برای پذیرش مسئولانه هوش مصنوعی در استخدام

وضعیت فعلی هوش مصنوعی در استخدام

سیستمهای ردیابی متقاضی (ATS) در استفاده از هوش مصنوعی در استخدام با تمرکز اساسی بر افزایش کیفیت و کارایی شیوههای استخدام پیشگام شدند.

با ظهور هوش مصنوعی مولد، کاربردهای هوش مصنوعی در استخدام به طور چشمگیری گسترش یافته است. این شکل پیشرفته از هوش مصنوعی فراتر از سادهسازی فرآیندها میرود و بر هدایت سطوح بالاتر شخصیسازی، بینشهای تحلیلی پیشبینیکننده پیشرفته برای پیشبینی موفقیت نامزدها و کاهش تعصب در تصمیمگیریهای استخدام تمرکز میکند.

سازمانهایی مانند Electrolux، Cigna، و Kuehne و Nagel همگی دستاوردهای قابل توجهی در بهرهوری، کیفیت خروجی و تأثیر منابع انسانی با اتخاذ هوش مصنوعی مولد گزارش کردهاند.

کسب و کارها می توانند هوش مصنوعی مولد را در طول مراحل مختلف فرآیند استخدام اعمال کنند:

منبع یابی

– نوشتن پروفایل های شغلی و آگهی های شغلی که مخاطبان خاصی را هدف قرار می دهند

– شخصی سازی آگهی های شغلی برای برجسته کردن الزامات خاص سازمانی

– حذف سوگیری در پروفایل ها و استفاده از زبان بی طرفانه جنسیتی.

غربالگری

– استفاده از تجزیه و تحلیل برای مطابقت دادن نامزدها با شرایط شغلی

– غربالگری خط اول نامزدها با استفاده از مصاحبه های ناهمزمان تعاملی.

مصاحبه ها

– تهیه سوالات مصاحبه مرتبط بر اساس شرایط شغلی و مشخصات نامزد

– ایجاد مطالعات موردی برای نامزدهای همسو با آزمون مهارت های خاص

– مصاحبه و امتیازدهی داوطلبان مبتنی بر هوش مصنوعی.

ما هوش مصنوعی را در استخدام با قاسم اسد سلام، مدیرعامل و یکی از بنیانگذاران Remotebase، شرکتی که به سازمانها در استخدام توسعهدهندگان نرمافزار از راه دور کمک میکند، بحث کردیم. در ادامه می توانید قسمت کامل آن را تماشا کنید:

با این حال، خطرات مرتبط با استفاده از هوش مصنوعی مولد در استخدام وجود دارد، و بسیاری از موارد استفاده غیرمسئولانه باعث شده است که متخصصان منابع انسانی تمایلی به آزمایش نداشته باشند. خطرات مربوط به حریم خصوصی، سوگیری و اعتماد نامزدها منجر به زیر سوال رفتن اخلاق استفاده از GenAI برای اهداف استخدام شده است.

بسیاری از متخصصان منابع انسانی گزارش می دهند که مطمئن نیستند که چگونه و در کجا باید از هوش مصنوعی استفاده کنند، که نگرانی هایی را در مورد حفظ حریم خصوصی و امنیت داده ها به عنوان موانع اصلی ایجاد می کند. تحقیقات ما در AIHR نشان میدهد که بسیاری از متخصصان منابع انسانی احساس بیعملی را تجربه میکنند و باید بیاموزند که چگونه با هوش مصنوعی شروع کنند یا چگونه استفاده ایمن از سیستمهای هوش مصنوعی را ارزیابی کنند.

استفاده از چارچوب ریسک هوش مصنوعی برای پذیرش مسئولانه هوش مصنوعی در استخدام

سازمانهایی که میخواهند هوش مصنوعی را در استخدام و سایر حوزههای منابع انسانی به طور مسئولانه اتخاذ کنند، باید رویکردی سیستماتیک داشته باشند. به این ترتیب، آنها می توانند ملاحظات اخلاقی و قانونی را مورد توجه قرار دهند، و همچنین اثربخشی استراتژیک و عملیاتی ابتکارات هوش مصنوعی در منابع انسانی را افزایش دهند.

چارچوب زیر که از مؤسسه ملی استاندارد و فناوری و مجمع جهانی اقتصاد اقتباس شده است، معیارها و سؤالات اساسی را که می توان برای ارزیابی قابلیت اعتماد سیستم های هوش مصنوعی مورد استفاده قرار داد، برجسته می کند.

با استفاده از این سوالات، سازمان ها می توانند سطح ریسک مرتبط با اجرا را تعیین کنند:

- ریسک قابل قبول به مواردی اطلاق میشود که ریسکها شناخته شده و کنترلهایی برای کاهش آنها وجود دارد. برای مثال، کنترلهایی برای کاهش سوگیری انتخاب در حین گزارش منبع در مورد متغیرهای جمعیتی وجود دارد.

- کاهش مورد نیاز مواردی را برجسته می کند که قبل از در نظر گرفتن پذیرش باید کنترل های بیشتری اجرا شود. به عنوان مثال، فرآیندی برای بررسی تصمیمات هوش مصنوعی در یک دوره زمانی متناسب با الزامات شغلی حیاتی باید اجرا شود.

- ریسک غیرقابل قبول به مواردی اطلاق می شود که بدون توجه به کنترل ها، پتانسیل آسیب به طور قابل توجهی بیشتر از سود درک شده است. به عنوان مثال، جایی که هوش مصنوعی به دلیل توصیه ها و پیش بینی های خود باعث آسیب می شود.

نکته مهم این است که این ویژگی ها به هم مرتبط هستند و هنگام ارزیابی ریسک هوش مصنوعی، باید در رابطه با یکدیگر بررسی شوند. سازمانها باید برای اطمینان از پذیرش مسئولانه و مدیریت موثر ریسک استفاده از هوش مصنوعی به عنوان بخشی از شیوههای استخدام خود، معاوضههایی انجام دهند.

عملی کردن مدل

شرکت فرضی ما، TX Energy، یک تجارت بزرگ تولیدی است که بر توسعه سیستمهای انرژی خورشیدی متمرکز شده است. آنها رشد قابل توجهی داشته اند و نیروی کار در سه سال گذشته رشد قابل توجهی داشته است. آنها در حال بررسی پیاده سازی فناوری های جدید GenAI در فرآیند استخدام خود برای دستیابی به مزایای زیر هستند:

- منبع یابی فعال استعدادهای بسیار حیاتی، مانند مهندسان

- مصاحبه با برنامه های استخدامی با حجم بالا مانند خدمات مشتری انجام دهید

- برای درک معیارهای موفقیت مشاوران بالقوه پیاده سازی، تجزیه و تحلیل پیش بینی را بهتر هدایت کنید.

با استفاده از چارچوب بالا، TX Energy ریسک و قابل اعتماد بودن راه حل را به شرح زیر ارزیابی می کند:

| معیارها | ملاحظات انرژی TX | پاسخ | رتبه بندی ریسک |

| روایی و پایایی | در طول غربالگری، آیا سیستم هوش مصنوعی بر اساس الزامات شغلی خاص، نامزدها را به دقت بررسی می کند یا معیارهای غیر مرتبط بر تصمیمات غربالگری تأثیر می گذارد؟ | این سیستم کنترلهایی را تنظیم کرده است که نمونهای از نامزدهای غربالشده را ترسیم میکند و معیارهایی را برای رد صلاحیت نامزدها گزارش میدهد. | ریسک قابل قبول |

| ایمنی | در طول استخدام، آیا هوش مصنوعی به طور ناخواسته منجر به محدود کردن فرصتهای برابر برخی از گروههای اقلیت برای به دست آوردن شغل میشود؟ | این سیستم به مدیران استخدام داشبوردی ارائه می دهد که جمعیت شناسی استخر استعدادها را برای تعیین روند ردیابی می کند. | ریسک قابل قبول |

| امنیت و انعطاف پذیری | آیا در طول مدیریت رکورد، داده ها با یک سیاست مدیریت مجموعه ایمن می شوند؟ | این سیستم ایمن است و با پروتکل ها و چارچوب های مختلف امنیت داده ها هماهنگ است | ریسک قابل قبول |

| پاسخگویی و شفافیت | سطح شفافیت تعامل و تعامل با هوش مصنوعی در طول تجربه نامزد چقدر است؟ | این سیستم به طور فعال به نامزدها ارتباط نمی دهد که تعاملات مبتنی بر هوش مصنوعی است. تخفیف در ارتباط با نامزدها لازم است. |

کاهش مورد نیاز است |

| قابل توضیح و تفسیر پذیری | آیا توصیههای مبتنی بر هوش مصنوعی در هنگام غربالگری و مصاحبه با انتظارات هنگام انجام کنترلهای کیفی همراه است؟ | سیستم در مورد تصمیمات استخدام گزارش می دهد، با این حال نیاز به یک فرآیند کیفیت وجود دارد که خروجی ها را هر سه ماه یکبار ارزیابی می کند | کاهش مورد نیاز است |

| بهبود حریم خصوصی | تعامل هوش مصنوعی با نامزد چگونه است و اطلاعات شخصی چگونه مدیریت می شود؟ | اطلاعات شخصی بر اساس پروتکلهای دادهای مدیریت میشوند، و لحن نحوه ارتباط هوش مصنوعی به طور مداوم از طریق تجزیه و تحلیل احساسات ارزیابی میشود. | ریسک قابل قبول |

| انصاف | آیا هوش مصنوعی در طول فرآیند غربالگری و انتخاب، علیه گروه خاصی تبعیض قائل است؟ | گزارش استثنایی برای نظارت بر تصمیمات استخدام بر اساس معیارهای کلیدی مانند جمعیت شناسی در دسترس است. | ریسک قابل قبول |

پس از این تجزیه و تحلیل کامل، TX Energy تصمیم گرفته است راه حل هوش مصنوعی را اتخاذ کند و یک برنامه آزمایشی 3 ماهه را آغاز کند. این مرحله مقدماتی با هدف کاهش موثر ریسکهای شناساییشده، کنترلهای قبلی را آزمایش میکند.

این رویکرد استراتژیک تضمین میکند که چالشهای بالقوه در یک محیط کنترلشده مورد توجه قرار میگیرند، و راه را برای انتقال آرام به یک پیادهسازی در مقیاس بزرگ پس از تکمیل موفقیتآمیز پایلوت هموار میکند.

کلمات پایانی

ما هنوز در ابتدای انقلاب هوش مصنوعی در منابع انسانی هستیم. از آنجایی که سازمانها هوش مصنوعی را به طور گستردهتری در استخدام و فراتر از آن اتخاذ میکنند، باید پایه محکمی برای ارزیابی قابلیت اعتماد سیستمهای هوش مصنوعی و استفاده مسئولانه از آنها داشته باشند.

هوش مصنوعی فرصتهای قابل توجهی را برای متخصصان منابع انسانی فراهم میکند، اما مهم است که منافع را با رویکرد پذیرش مسئولانه که خطرات مرتبط با این فناوریها را در نظر میگیرد و سازمانها را قادر میسازد تا تصمیمگیری آگاهانه در مورد استفاده از آنها اتخاذ کنند، متعادل کنیم.